Kürzlich wurde die Genauigkeit von ChatGPT, der neuen KI-Maschine, die viele Menschen destabilisiert hat, widerlegt. Heute beginnen wir mehr denn je damit, die Fähigkeit der KI, den Menschen in allen Berufen zu ersetzen, kritisch zu prüfen, weil die Bedrohung realer wird. Während an mehreren Fallstudien demonstriert wurde, dass der Mensch unersetzlich ist, macht eine einfache Bildsuche nach „happy white woman“ immer noch die Runde.

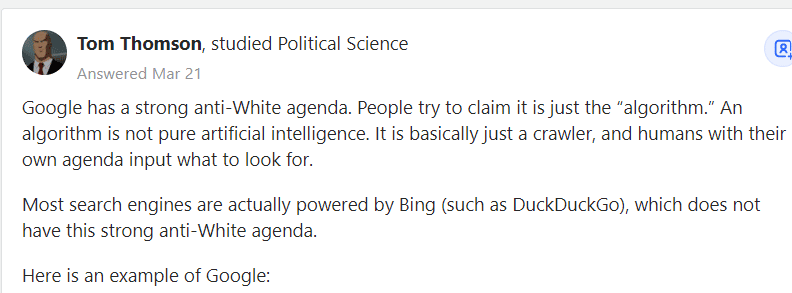

Ein Quora-Benutzer fragte, warum es unerwartete Ergebnisse gibt, wenn „Happy White Women“ gegoogelt wird. Die Antworten waren wie folgt:

“Google hat eine starke Anti-Weiß-Agenda. Die Leute versuchen zu behaupten, es sei nur der „Algorithmus“. Ein Algorithmus ist keine reine künstliche Intelligenz. Es ist im Grunde nur ein Crawler, und Menschen mit ihrer eigenen Agenda geben vor, wonach gesucht werden soll. Die meisten Suchmaschinen werden tatsächlich von Bing betrieben (wie DuckDuckGo), das nicht über dieses starke Anti-Weiß verfügt Agenda.”

Tom Thomson

Tom fügte weiter hinzu;

“Sie versuchen, eine Agenda voranzutreiben. Sie hassen Weiße. Es ist in Ordnung, weiß zu sein.”

Obwohl ich Tom in dieser Hinsicht nicht völlig widersprechen konnte, beschloss ich, selbst herauszufinden, was ich glauben sollte, und evidenzbasierte Ideen darüber anzubieten, warum die Suchergebnisse so sind.

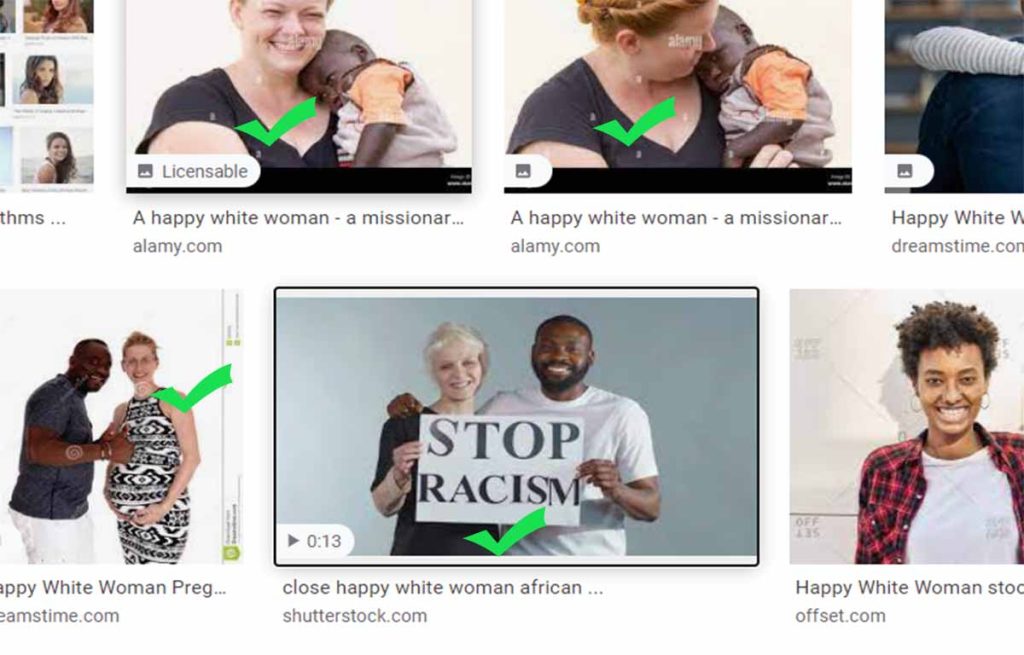

Könnte Google rassistisch sein, schwarze Bevölkerungsgruppen fördern oder versuchen, die Einheit zwischen den Rassen zu fördern? Ich hüpfte in meine Google-Suche und tippte das Stichwort „Happy White Woman“ ein. Diese Ergebnisse (siehe unten) stimmten weitgehend mit dieser Annahme überein (ich habe einige davon mit einem grünen Häkchen markiert, das unten gezeigt wird).

Aber was denkst du darüber? Warum zeigt Google unerwartete Ergebnisse an, wenn in der Suchmaschine nach dem Ausdruck “happy white woman“ gesucht wird?

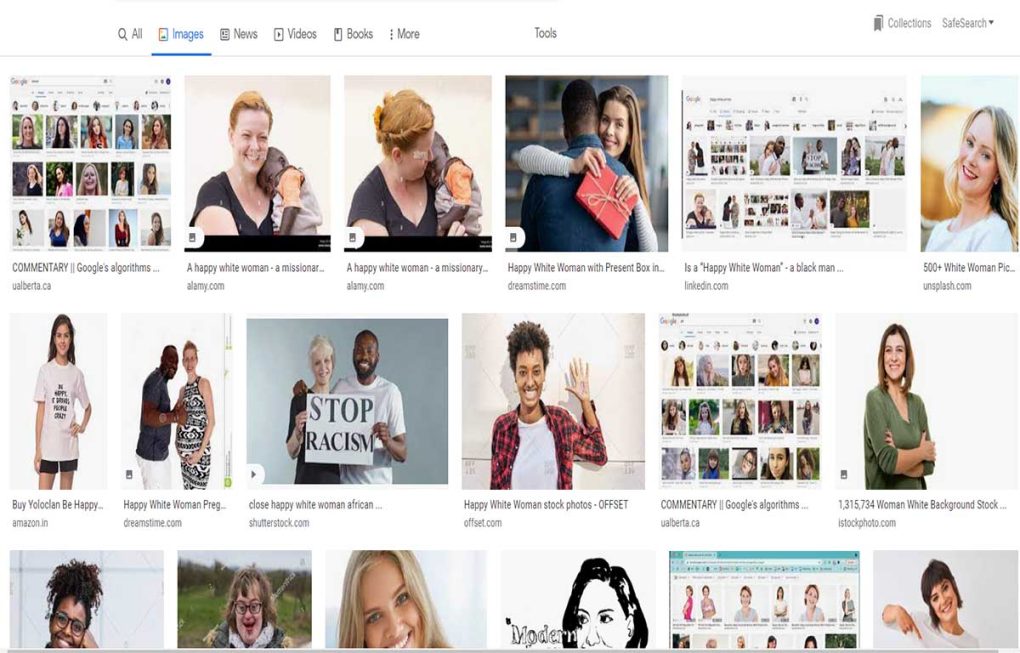

Wenn Sie dies noch nicht gesehen haben, öffnen Sie einen neuen Browser-Tab und geben Sie “happy white woman“ in die Google-Suchleiste ein. Klicken Sie nach dem Öffnen auf “Bilder“, um nur Bildergebnisse für diesen Satz anzuzeigen. Diese Image-Ergebnisse für “glückliche weiße Frau” sind seit einiger Zeit ein Thema für Kontroversen. Aber wir prüfen jetzt die Möglichkeiten hier.

Bei der Google-Suche sollte das Ergebnis so aussehen.

Bildergebnisse für “happy white woman” bei Google scheinen ziemlich unerwartet zu sein. Wir sehen mehrere Bilder von glücklichen weißen Frauen, die mit schwarzen Männern stehen oder sie umarmen. Versucht Google uns etwas mitzuteilen, was wir nicht wissen? Oder hängt das „Glück“ „weißer Frauen“ von schwarzen Männern ab?

Vielleicht ist dies ein weiterer KI-Fehler, der bald behoben werden könnte, oder Google fördert absichtlich BLM-Propaganda. Diese Beobachtung besteht jedoch schon seit einiger Zeit, und alle diese Behauptungen basieren nur auf Annahmen. Um genau herauszufinden, warum die Ergebnisse so sind, müssen wir einige Dinge ausprobieren.

Zuerst entschied ich mich, nach dem verwandten Ausdruck „happy black woman“ zu suchen, um zu sehen, ob Google auch gemischte Ergebnisse liefern würde. Hier war, was ich gefunden habe.

Wie Sie sehen können, stimmten die Ergebnisse mit “glückliche schwarze Frau” überein. Google hat die Bildergebnisse für schwarze Frauen nicht gemischt, wie es für “glückliche weiße Frauen” der Fall war. Diese Art wirft eine andere Reihe von Debatten darüber auf, warum dies so ist.

Nur um es klarer zu verstehen, habe ich die Suchergebnisse für das gleiche Keyword auf zwei anderen Suchmaschinen verglichen – Bing und DuckDuckGo.

Bing ist Googles engster Suchmaschinenkonkurrent. Das gleiche Suchwort in der Bing-Suche ergab das folgende Bildergebnis.

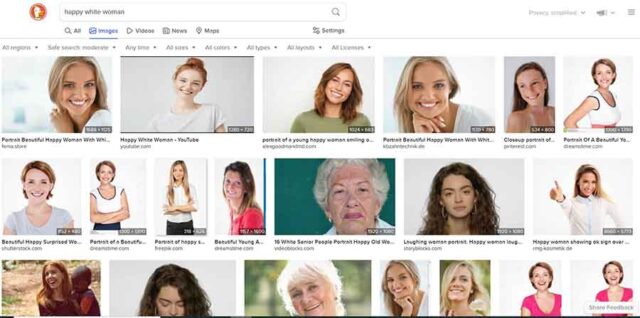

DuckDuckGo ist eine weitere Suchmaschine, die volle Privatsphäre für den Suchenden beansprucht. Das bedeutet, dass Benutzer nicht verfolgt werden, um Ergebnisse anzubieten, die durch Benutzervoreingenommenheit oder Standort beeinflusst werden. Eine Bildersuche nach „happy white woman“ auf DuckDuckGo ergab folgendes Ergebnis.

Jetzt, da wir fast alles haben, was wir brauchen, um diesen Fall zu lösen, können wir anfangen, die Frage zu beantworten, warum Suchergebnisse für „glückliche weiße Frau“ ziemlich unangemessen sind?

Hier sind einige mögliche Erklärungen für diese Anomalie;

- Manipulation der Suchabsicht.

- Google kann voreingenommen, rassistisch und nicht vertrauenswürdig sein.

- KI-Algorithmen sind im Allgemeinen möglicherweise nicht so intelligent, wie wir denken.

Manipulation der Suchabsicht durch BLM-Gruppen

Google ist die führende Suchmaschine, die heute von fast allen Menschen auf der Welt verwendet wird, die Zugang zum Internet haben. Es verfügt über eine große Datenbank mit Informationen, die von seinem Suchalgorithmus organisiert werden. Leider ist der Suchalgorithmus von Google nicht narrensicher.

Als im Google-Suchforum die Frage „warum diese unerwarteten Suchergebnisse angezeigt werden“ gestellt wurde, antwortete ein Platin-Produktexperte im Google-Forum wie folgt:

Normalerweise gibt es einfache Erklärungen, wie zum Beispiel, dass die Suchmaschine das Wort Weiß so interpretiert hat, dass es die Hintergrundfarbe bedeutet, nicht die Farbe der Person; aber interpretierte das Wort schwarz, um die Person zu bedeuten.

In Bezug auf Bilder stammen viele der Ergebnisse von Stockfotos-Websites, und sie kategorisieren ihren Inhalt anhand von Themen (einschließlich Geschlecht, Farbe, Hintergrundfarbe usw.), die das verzerren, was Sie in der Google-Bildsuche sehen. Beachten Sie, dass in Ihrer Frage das Wort „glücklich“ verwendet wurde, ein Begriff, der häufig von Websites mit Stockfotos verwendet wird, wodurch es wahrscheinlicher wird, dass die Ergebnisse voller Stockfotos sind.

Meist geht es um die verwendete Sprache, die konkrete Formulierung der Anfrage. Google indiziert den Wortlaut anderer Websites, sodass seine Ergebnisse eher gesellschaftliche Vorurteile widerspiegeln oder einfach nur die Art und Weise widerspiegeln, wie Wörter im wirklichen Leben verwendet werden.

Denken Sie daran, dass einige der Leute, die diese Frage in den sozialen Medien teilen, dies nicht mit den besten Absichten tun und genau wissen, dass es sich um einen Sprachtrick handelt. Diese Frage wurde wiederholt von Menschen gestellt, die gerne Rassenhetze betreiben, aber auch von anderen, die dazu verleitet wurden, ehrlich empört über eine wahrgenommene rassistische Voreingenommenheit zu sein.

Ein weiterer Gedanke: Googles automatisierte Algorithmen sind nicht vor denselben Vorurteilen gefeit wie der Rest der Gesellschaft.

Dies zeigt mehrere Dinge, aber es zeigt auch, dass spezielle Interessengruppen der radikalen Rechten nach „Happy White Women“ suchen und wiederholt auf interrassische Bilder klicken könnten, um die Voreingenommenheit der Google-Suche zu verstärken und die Suchergebnisse als Beweis gegen Google für BLM-Propaganda zu verwenden. Aus der obigen Erklärung könnte dies tatsächlich mit dem Algorithmus von Google funktionieren.

Dieser Vorschlag behauptet, dass Google die BLM-Propaganda möglicherweise gegen destruktive Bemühungen von Gruppen der radikalen Rechten drängt, wo sie so programmiert ist, dass sie rassenfreundlichere Ergebnisse anzeigt, wenn Benutzer nach Schlüsselwörtern wie „Happy White Woman“ suchen, die möglicherweise rassistische Absichten haben . Und jetzt gibt es einen Gegenanstieg von Rassenködern, die jetzt behaupten, Google sei rassistisch zugunsten von Schwarzen.

David Junge fand nach gründlicher Prüfung heraus, dass es keine rassenbasierte Suchabsicht gibt, die mit „glückliche weiße Frau“ in Verbindung gebracht wird. Und wenn Google „glückliche weiße Frauen“ als Mittel zum Ködern von Rassen betrachtet, würden wir erwarten, dass andere Suchmaschinen wie Bing, DuckDuckGo und Yahoo es ebenfalls aufgreifen, was anscheinend nicht der Fall ist.

Google selbst mag heimlich für BLM sein

Das ist natürlich das interessanteste Argument der radikalen Rechten. Sie behaupten, dass Google direkt an der BLM-Propaganda beteiligt sein könnte, da dieses Auftreten gemischter Rassenergebnisse für eine Suche nach „Happy White Women“ nur bei Google und nicht bei anderen Suchmaschinen zu sehen ist. Sie argumentieren nicht, dass BLM-Gruppen einen Weg gefunden haben, den Suchalgorithmus zu beeinflussen, sondern dass Google BLM und Minderheitengruppen offen unterstützt.

Dies ist jedoch sehr unwahrscheinlich, da Google seine Suchergebnisse nicht absichtlich ändern würde, um eine Gruppe zu bewerben. Das würde Misstrauen, Anfragen und Rechtsstreitigkeiten hervorrufen, und zu glauben, dass Google weitermachen würde, ist äußerst unwahrscheinlich.

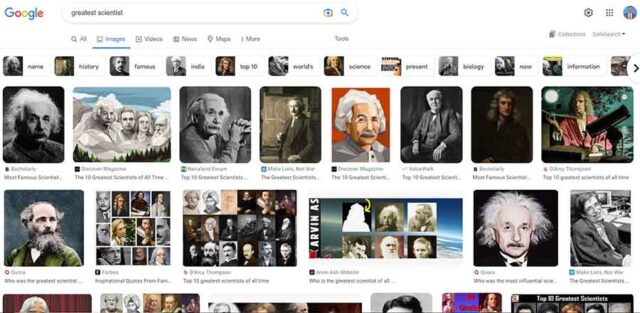

Hier ist eine andere Möglichkeit, es zu betrachten. Wenn Google bewusst BLM oder Minderheitengruppen fördert, sollte sich dies auch in anderen verwandten Suchbegriffen widerspiegeln. Beispielsweise sollte eine Suche nach “Greatest Scientist” mehr Personen in den Minderheitengruppen anzeigen, wenn Google tatsächlich solche Gruppen fördert, dies jedoch eindeutig nicht tut, wie in der Abbildung unten gezeigt.

Denken Sie daran, dass 2019 eine weitere ähnliche Anschuldigung gegen Google erhoben wurde, in der behauptet wurde, dass der Algorithmus von Google schwarze Frauen und Mädchen diskriminiert. In der Veröffentlichung wurde darauf hingewiesen, dass eine Suche nach „Mädchen“ oder „Frauen“ nur weiße Mädchen bzw. Frauen anzeigt.

Die Widersprüchlichkeiten in den Behauptungen gegen Google zeigen, dass es keine sachlichen Beweise dafür gibt, dass Google voreingenommen ist und BLM und Minderheitengruppen absichtlich fördert.

KI-Algorithmen sind möglicherweise nicht so intelligent, wie wir denken

Wie der Google-Forum-Experte oben dargestellt hat, sind der Google-Suchalgorithmus und damit alle Suchmaschinenalgorithmen nicht immun gegen die Vorurteile der Gesellschaft. Noch wichtiger ist, dass Suchalgorithmen aufgrund der Kategorisierung der Bilder falsch verstehen können, wonach gesucht wird.

Die meisten Bilder, die von vielen Websites verwendet werden, stammen von Bildagenturen, die ihre Bilder möglicherweise unangemessen kategorisieren. Der alternative „alt“-Text in Bildern beschreibt auch, was ein Bild sein soll, und das kann auch falsch geschrieben sein.

Google verlässt sich wie andere Suchmaschinen auf diese Informationen, um Ergebnisse aus seiner großen Datenbank abzurufen. Die ursprüngliche Kategorisierung eines Bildes „weiße Frauen gemischter Abstammung“ in einer Bildkategorie „weiße Frauen“ könnte beeinflussen, wie Google diese Bilder sieht.

Zusätzlich zu der Suchabsicht, über die ich zuvor gesprochen habe, können die Ergebnisse das von Google empfangene Signal darüber widerspiegeln, was der wahre Grund hinter der Suche ist, und daher Ergebnisse basierend auf dem anzeigen, was die Leute wahrnehmen, dass sie mehr sehen möchten.

Schließlich kann der KI-Algorithmus von Google das Wort „weiß“ falsch interpretieren, um Hintergrundfarbe zu bedeuten und glückliche Frauen auf einem weißen Hintergrund anzuzeigen.

Aber was auch immer der Fall ist, wir sehen jetzt, dass Google und andere Suchalgorithmen möglicherweise nicht so intelligent sind, wie wir dachten.

Meine Gedanken zu diesem Thema

Die meisten globalen Marken nutzen ihren Einfluss, um die Einheit zwischen den Rassen zu fördern, sich gegen politische Gewalt, Kindes- und Frauenmissbrauch auszusprechen usw. Google ist eine globale Marke, die möglicherweise nicht mit soziokulturellen Verstößen wie Rassismus und anderen in Verbindung gebracht werden möchte. Dies könnte der Behauptung Glaubwürdigkeit verleihen, dass Google seinen Algorithmus optimieren könnte, um sozial integrativer zu sein, indem es Suchdaten sammelt und die Absichten versteht, nach denen in Bezug auf ein bestimmtes Thema gesucht wird.

Die Suche nach „glückliche weiße Frau“, nachdem Sie von der Verschwörung gehört haben, dass die Ergebnisse einige unerwartete Ergebnisse zeigen, beeinflusst bereits Ihre Suchabsicht – Sie möchten die Behauptungen bestätigen oder widerlegen. Dies wirkt sich in gewisser Weise auf Ihre Interaktionen mit den Suchergebnissen aus, ein Verhalten, das Google erkennen und anpassen kann, um zukünftige Ergebnisse zum Suchbegriff zu ändern.

Letzte Worte

Die Google-Suche nach „Happy white woman“ zeigt Ergebnisse mit glücklichen weißen Frauen und einigen schwarzen Männern. Dieses Verhalten wird bei anderen Suchmaschinen wie Bing und DuckDuckGo nicht beobachtet. Dies hat im Internet zu Kontroversen darüber geführt, wie dieses Suchverhalten bei Google einen rassistischen oder BLM-Unterton haben könnte.

Die bisher untersuchten Beweise haben keine derartige Voreingenommenheit gezeigt. Die wahrscheinlichste Erklärung ist, wie sich Suchabsichten auf Suchergebnisse auswirken, und die Rolle der Bildbeschreibung auf Stockfotos-Websites kann bestimmen, was für einen bestimmten Schlüsselwortsatz wie „Happy white woman“ angezeigt wird.